| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | ||||||

| 2 | 3 | 4 | 5 | 6 | 7 | 8 |

| 9 | 10 | 11 | 12 | 13 | 14 | 15 |

| 16 | 17 | 18 | 19 | 20 | 21 | 22 |

| 23 | 24 | 25 | 26 | 27 | 28 |

- flask

- deep learning

- 웹해킹

- Scala

- 경제

- webhacking

- BOF 원정대

- c

- Shellcode

- ChatGPT

- php

- hackthissite

- 딥러닝

- 백엔드

- c++

- Linux

- mysql

- 챗GPT

- BOF

- 러닝 스칼라

- 리눅스

- backend

- hacking

- Python

- 파이썬

- 러닝스칼라

- 인공지능

- Javascript

- hackerschool

- Web

- Today

- Total

목록Artificial Neural Network (2)

jam 블로그

신경망 (Artificial Neural Network, ANN) 스터디 용으로 Deep Learning from Scratch 2 책을 참고로 정리한 것입니다. 앞 게시물 에 이어서 신경망의 학습에 대해서 정리하였습니다. 신경망의 성능을 나타내는 척도로는 손실 loss을(를) 사용합니다. 손실은 손실함수 (loss function)를 사용하여 구합니다. 손실 함수로는 아래와 같이 있습니다. (계속 추가 예정) 교차 엔트로피 오차 (Cross Entropy Error) 평균 제곱 오차 (Mean Squared Error) Mean Absolute Error Mean Absolute Percentage Error Mean Squared Logarithmic Error Hinge Categorical Cro..

Artificial Neural Network 1

Artificial Neural Network 1

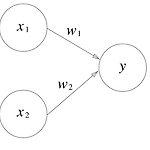

신경망 (Artificial Neural Network, ANN) 스터디 용으로 Deep Learning from Scratch 2 책을 참고로 정리한 것입니다. 신경망을 알기 전에 기본이 되는 퍼셉트론(Perceptron)을 먼저 알아봅시다. 단층 퍼셉트론은 다수의 신호를 입력으로 받아 하나의 신호를 출력. 위 그림에서 원은 뉴런 혹은 노드라고 하며, 입력 신호가 y 뉴런에 보내질 때는 각 고유한 가중치가 곱해집니다. 뉴런에서 보내온 신호의 총합이 정해진 한계를 너어선 때만 1을 출력합니다. 다음과 같이 수식으로 나타낼 수 있습니다. $$ y = \begin{cases} 0 & (w_1x_1 + w_2x_2 \leq \theta) \\\\ 1 & (w_1x_1 + w_2x_2 > \theta) \end..