| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | 4 | 5 | ||

| 6 | 7 | 8 | 9 | 10 | 11 | 12 |

| 13 | 14 | 15 | 16 | 17 | 18 | 19 |

| 20 | 21 | 22 | 23 | 24 | 25 | 26 |

| 27 | 28 | 29 | 30 |

- 인공지능

- backend

- 백엔드

- Web

- Python

- Linux

- 딥러닝

- hackthissite

- hackerschool

- deep learning

- 파이썬

- webhacking

- 경제

- php

- 러닝스칼라

- c

- 챗GPT

- 러닝 스칼라

- BOF

- mysql

- ChatGPT

- 리눅스

- 웹해킹

- hacking

- flask

- Javascript

- Scala

- c++

- Shellcode

- BOF 원정대

- Today

- Total

목록인공지능 (10)

jam 블로그

Abstract 현재 사전 훈련된 모델들(ELMo GPT BERT XLNet)이 다양한 언어 이해 과제에서 좋은 성적을 거두고 있음. 그러나 모델들이 너무 커서 모바일이나 Edge 기기에서 사용하기가 어려움. 그래서 나온 knowledge distillation이 있지만 원래 Teacher 모델과는 다른 어휘로 Student 모델을 산출하는데에는 효과가 없음. 이 논문에서 훨씬 더 작은 어휘와 낮은 임베딩, hidden state dimensions을 가진 student 모델을 훈련시키기 위해 새로운 knowledge distillation을 도입함. Teacher, student 모델을 동시에 훈련시켜 student 어휘를 위한 최적의 워드 임베딩을 얻는 dualtrain 메커니증을 채용. teache..

자연어 처리(Natural Language Processing, NLP) 스터디 용으로 Deep Learning from Scratch 2 책을 참고로 정리한 것입니다. Word Embedding에 대해서 알아봅니다. 시소러스를 활용한 기법 통계 기반 기법 추론 기반 기법(word2vec) Latent semantic analysis Brown clustering Glove fastText Gensim 위와 같이 다양하게 있으며, 해당 책에서는 볼드로 된 3가지를 설명합니다. 시소러스 유의어 사전으로, '뜻이 같은 단어(동의어)'나 '뜻이 비슷한 단어(유의어)'가 한 그룹으로 분류 자연어 처리에 이용되는 시소러스는 단어 사이의 '상위, 하위' 또는 '전체..

원-핫 인코딩 각 단어의 인덱스를 정한 후 각 단어의 벡터를 각 단어에 해당하는 인덱스의 값을 1로 표현하는 방법 장점 : 간단하고 이애하기 쉽다. 단점 : 단어 수가 많아지면 많아질수록 벡터의 크기가 커지기 때문에 공간이 많이 사용되고 비효율적. 단어의 의미나 특성 같은 것들이 전혀 표현되지 않는 것. 코딩 순서 형태소 분석기로 문장들을 자릅니다. 자른 문장들을 합쳐서 하나의 사전으로 만듭니다. 사전에 등록된 단어의 인덱스를 1로 바꾸고 나머지는 0으로 넣은 배열을 출력합니다. 단점 타파 카운터 기반 방법 특이값 분해 (Singular Value Decomposition, SVD) 잠재의미분석 (Latent Semantic Analysis, LSA) Hyperspace Analogue to Langua..

신경망 (Artificial Neural Network, ANN) 스터디 용으로 Deep Learning from Scratch 2 책을 참고로 정리한 것입니다. 앞 게시물 에 이어서 신경망의 학습에 대해서 정리하였습니다. 신경망의 성능을 나타내는 척도로는 손실 loss을(를) 사용합니다. 손실은 손실함수 (loss function)를 사용하여 구합니다. 손실 함수로는 아래와 같이 있습니다. (계속 추가 예정) 교차 엔트로피 오차 (Cross Entropy Error) 평균 제곱 오차 (Mean Squared Error) Mean Absolute Error Mean Absolute Percentage Error Mean Squared Logarithmic Error Hinge Categorical Cro..

Artificial Neural Network 1

Artificial Neural Network 1

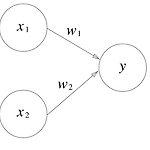

신경망 (Artificial Neural Network, ANN) 스터디 용으로 Deep Learning from Scratch 2 책을 참고로 정리한 것입니다. 신경망을 알기 전에 기본이 되는 퍼셉트론(Perceptron)을 먼저 알아봅시다. 단층 퍼셉트론은 다수의 신호를 입력으로 받아 하나의 신호를 출력. 위 그림에서 원은 뉴런 혹은 노드라고 하며, 입력 신호가 y 뉴런에 보내질 때는 각 고유한 가중치가 곱해집니다. 뉴런에서 보내온 신호의 총합이 정해진 한계를 너어선 때만 1을 출력합니다. 다음과 같이 수식으로 나타낼 수 있습니다. $$ y = \begin{cases} 0 & (w_1x_1 + w_2x_2 \leq \theta) \\\\ 1 & (w_1x_1 + w_2x_2 > \theta) \end..